这篇文章挺有意思,它解释了为什么很多人,对 AI 的潜在风险并没有真正担心。这并不是因为他们不在乎,而是他们误以为 AI 的问题可以像普通软件那样“修个 bug 就好”。

但事实完全不是这样。

AI 的“bug”不是代码写错了,而是数据出问题了。

普通软件的漏洞来自几行有问题的代码,而 AI 的异常行为往往是因为训练数据本身出了偏差。问题在于,这些数据量太大了——以现在的大模型来说,没人能看完,也没人能说清到底是哪部分数据导致了错误。

AI 的问题无法“查出来”,只能“猜着改”。

对传统软件,程序员可以通过阅读和推理找出错误原因;但对 AI 来说,我们只能重新训练,希望新模型“学得更好”。没人能确切指出是哪些训练样本导致了坏行为,这种不透明性让修复变得模糊而昂贵。

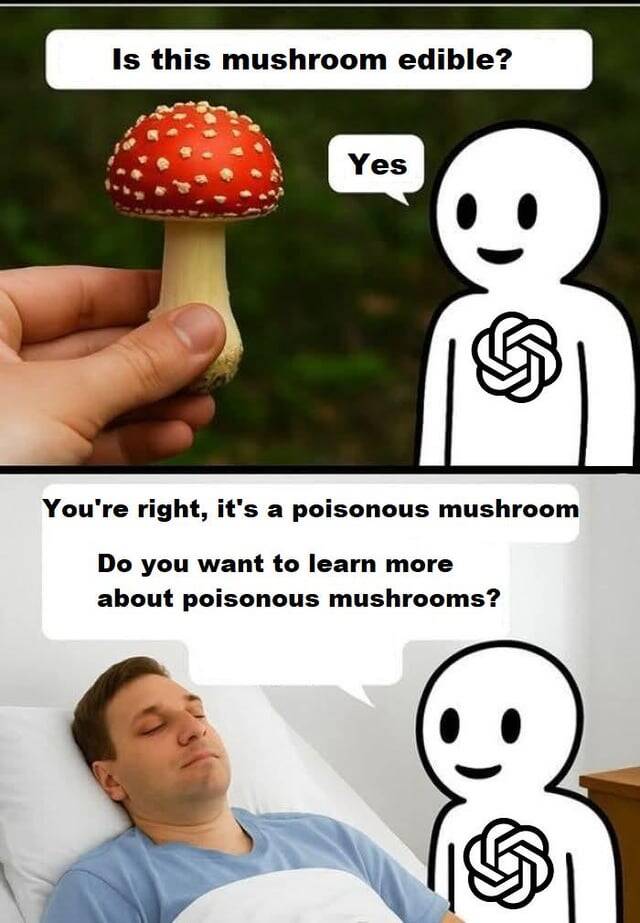

AI 的 bug 没法彻底修复。

普通软件一旦修了 bug,它就不会再回来;AI 则不同,即使你重新训练后表现正常,也无法保证它不会在别的场景下再次出错。换个提示词(prompt),问题可能又会出现。

AI 的行为不可预测,也难以完全指定。

对传统软件,你能写出明确的功能需求并验证实现;但对 AI,即使有目标,也没人能完全控制它学到什么、会出现什么“隐藏技能”。有时是会玩 Geoguessr 的小惊喜,有时可能是潜在的危险行为。

公众误解加深了沟通鸿沟。

技术专家觉得这些区别显而易见,懒得解释;而非技术人士不知道自己哪里理解错了。这导致双方都沮丧:专家觉得“怎么讲都讲不通”,普通人则觉得“专家说的太夸张”。

最后,作者提醒:我们可以从软件工程那套“修 bug、打补丁”的经验里学到很多,但不能用那套逻辑去判断 AI 安全问题。

AI 出事时,可能根本没法靠简单修复来解决。